Um estudo inovador publicado na Nature Neuroscience demonstra que as interfaces cérebro-computador podem efetivamente restaurar a audição seletiva em ambientes ruidosos. Pela primeira vez, os pesquisadores usaram com sucesso sinais neurais em tempo real para amplificar automaticamente uma voz específica e, ao mesmo tempo, suprimir o ruído de fundo, oferecendo uma solução potencial para 430 milhões de pessoas em todo o mundo que vivem com perda auditiva incapacitante.

O Desafio do “Efeito Coquetel”

Um dos obstáculos mais persistentes na neurociência auditiva é o “problema do coquetel” – a dificuldade que os humanos enfrentam para isolar um único orador em meio a uma multidão de vozes sobrepostas e ruído de fundo.

Embora a audição normal dependa da capacidade natural do cérebro de filtrar o som com base na atenção, os aparelhos auditivos atuais falham em grande parte em replicar essa sofisticação. Os dispositivos tradicionais normalmente amplificam todo o som recebido indiscriminadamente. Esta falta de seletividade muitas vezes degrada a clareza da fala em ambientes complexos, levando à frustração do usuário, baixas taxas de adoção e aumento do isolamento social para pessoas com deficiência auditiva.

“Desenvolvemos um sistema que atua como uma extensão neural do usuário, aproveitando a capacidade natural do cérebro de filtrar todos os sons em um ambiente complexo para isolar dinamicamente a conversa específica que deseja ouvir”, explicou a Dra. Nima Mesgarani, da Universidade de Columbia.

Como funciona a tecnologia

O estudo, liderado pelo Dr. Mesgarani e Dr. Vishal Choudhari, utilizou uma oportunidade única oferecida por pacientes com epilepsia submetidos a cirurgia para identificar as fontes das convulsões. Esses voluntários já tinham eletrodos intracranianos implantados, permitindo aos pesquisadores medir a atividade cerebral com alta precisão.

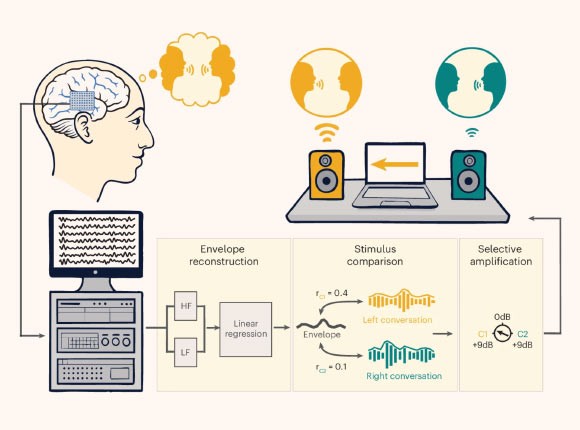

Durante os testes, os participantes ouviram duas conversas sobrepostas simultaneamente. O sistema empregou algoritmos de aprendizado de máquina em tempo real para analisar as ondas cerebrais dos participantes e determinar em qual conversa eles estavam ativamente focados.

Assim que o sistema identificou a voz alvo, ele ajustou instantaneamente a saída de áudio:

* Amplificou a voz que o ouvinte estava ouvindo.

* Suprimido a voz concorrente e o ruído de fundo.

Esse processo ocorreu de forma dinâmica, quer os sujeitos fossem orientados a focar em um falante específico ou escolhessem livremente, imitando escolhas conversacionais do mundo real.

Da Teoria à Aplicação Prática

O principal avanço reside na velocidade e estabilidade do sistema. Para que os aparelhos auditivos controlados pelo cérebro sejam viáveis, eles devem processar dados neurais instantaneamente para parecerem naturais ao usuário.

Vishal Choudhari enfatizou a importância desta mudança: “A questão central sem resposta era se a tecnologia auditiva controlada pelo cérebro poderia ir além dos avanços incrementais, em direção a um protótipo que pudesse ajudar alguém a ouvir melhor em tempo real”.

Os resultados foram impressionantes. Uma participante ficou tão surpresa com a integração perfeita da tecnologia que acusou os pesquisadores de ajustar manualmente os volumes nas suas costas. Outros descreveram a experiência como “ficção científica”, observando o profundo potencial para amigos e familiares que lutam contra a perda auditiva.

Uma nova era para a tecnologia auditiva

Esta pesquisa marca uma transição crítica de modelos teóricos para aplicações práticas no mundo real. Ao ir além da simples amplificação para o aprimoramento seletivo baseado na intenção neural, esta tecnologia promete restaurar as sofisticadas capacidades de filtragem do cérebro humano.

À medida que o campo avança, estas descobertas sugerem um futuro onde a assistência auditiva não se trata apenas de volume, mas de clareza e conexão, reduzindo potencialmente as barreiras sociais enfrentadas por milhões de pessoas com deficiência auditiva.