Штучний інтелект і тиша розуму: нова ера комунікації або загроза приватності?

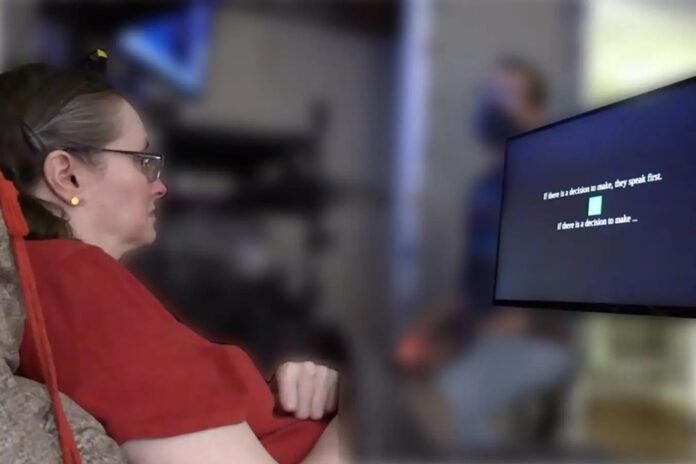

Уявіть собі світ, де паралізовані люди можуть спілкуватися, просто уявляючи слова. Де невисловлені думки, народжені в тиші розуму, можуть бути перетворені в мову і донесені до оточуючих. Ця мрія, яка здавалася науковою фантастикою, поступово стає реальністю завдяки розвитку інтерфейсів мозок-комп’ютер (BCI) і штучного інтелекту (ШІ). Недавні дослідження Стенфордського університету показали, що досить точно розшифровувати нейронну активність, що виникає приуява промови, відкриваючи нові горизонти для комунікації і, одночасно, піднімаючи серйозні питання про приватність і безпеку.

Як людина, яка давно цікавиться технологіями та їх впливом на суспільство, я бачу величезний потенціал у цьому прориві. Але, як і у випадку з будь-якою революційною технологією, важливо не тільки захоплюватися можливостями, але і критично оцінювати ризики.

Від спроб говорити до уявної мови: що змінилося?

Традиційні BCI, які розшифровують спроби вимовити слова, вимагають від користувача значних зусиль. Уявіть собі, як важко людині з паралічем намагатися сформувати слова, не маючи можливості рухати м’язами обличчя і горла. Це вимотує і обмежує можливості комунікації.

Ідея розшифровкиуявний промови-це справжній ковток свіжого повітря. Замість того, щоб боротися з фізичними обмеженнями, користувач просто уявляє, що говорить. Це значно знижує навантаження і робить комунікацію більш природною і комфортною. Дослідження Стенфорда, яке показало точність розшифровки в 74%, – це вражаючий результат, особливо з огляду на складність завдання.

Однак, варто відзначити, що точність, хоч і обнадійлива, все ще далека від ідеалу. Як справедливо зауважив один з учасників дослідження, Бенджамін Олдерсон-Дей, система працює тільки з дуже простими прикладами мови. Ми ще дуже далекі від можливості передавати складні думки і найпотаємніші ідеї.

Етика та конфіденційність: найбільша проблема

Але найголовніше-це етичні та юридичні питання, які виникають у зв’язку з цією технологією. Можливість розшифровки навіть уявної мови піднімає питання про приватність найпотаємніших думок.

Уявіть собі ситуацію, коли система BCI, підключена до вашого мозку, ненавмисно “зчитує” ваші думки, які ви не хотіли б нікому доносити. Це може бути не тільки незручно, але й потенційно небезпечно. Як захистити свої думки від несанкціонованого доступу?

У статті згадується ” пароль “-фраза” Чітті-чітті-бах-бах”, яку необхідно було думати, щоб система активувалася. Це, безумовно, важливий крок у напрямку захисту приватності, але, на мій погляд, недостатньо ефективний. Уявіть, що зловмисник зможе перехопити і використовувати цей пароль.

Більш того, навіть якщо пароль надійно захищений, завжди є ризик випадкової активації системи. Уявіть, що ви просто думаєте про щось, що випадково активує систему і починає транслювати ваші думки.

Як вирішити цю проблему? Я думаю, що необхідний багаторівневий захист, який включає не лише паролі, а й:

- Шифрування даних: Усі дані, отримані від BCI, повинні бути надійно зашифровані.

- Біометрична аутентифікація: Система повинна вимагати біометричної аутентифікації (наприклад, розпізнавання мозкових хвиль) перед активацією.

- Контроль користувача: Користувач повинен мати повний контроль над тим, які дані передаються і кому.

- Законодавче регулювання: Необхідно розробити законодавство, яке регулюватиме використання BCI та захищатиме права користувачів.

Більше, ніж просто спілкування: потенційні застосування

Не варто забувати і про інші потенційні застосування цієї технології. Крім допомоги людям з паралічем, BCI можуть бути використані:

- У медицині: Для діагностики та лікування психічних захворювань, а також для відновлення рухових функцій після інсульту.

- В освіті: Для поліпшення процесу навчання і запам’ятовування інформації.

- У розвагах: Для створення нових видів ігор і віртуальної реальності.

- У промисловості: Для управління складними системами і роботами.

Однак, перш ніж впроваджувати BCI в широке використання, необхідно ретельно вивчити всі потенційні ризики і розробити відповідні заходи безпеки.

Особистий досвід та роздуми

Я пам’ятаю, як у дитинстві читав науково-фантастичні книги про людей, які могли керувати своїми думками та передавати їх іншим. Тоді це здавалося нереальним. Зараз, завдяки розвитку технологій, це стає все більш близьким до реальності.

Але я також пам’ятаю, як ці книги часто піднімали питання про конфіденційність та контроль розуму. Ці питання залишаються актуальними і сьогодні. Ми повинні бути обережними, щоб не допустити, щоб технології, призначені для покращення нашого життя, стали загрозою нашій свободі та приватності.

Висновок: баланс між прогресом та ВІДПОВІДАЛЬНІСТЮ

Штучний інтелект, який читає думки, – це прорив, який може змінити світ. Він відкриває нові можливості для комунікації, медицини, освіти та інших областей. Але, як і будь-яка революційна технологія, він несе в собі ризики.

Нам необхідно знайти баланс між прогресом і відповідальністю. Ми повинні продовжувати розвивати цю технологію, але при цьому ретельно стежити за тим, щоб вона не порушувала наші права і свободи.

Нам потрібно розробити чіткі етичні та юридичні норми, які регулюватимуть використання BCI. Нам потрібно забезпечити, щоб користувачі мали повний контроль над своїми думками та даними.

Тільки тоді ми зможемо використати потенціал цієї технології для покращення нашого життя, не жертвуючи своєю приватністю та свободою. Майбутнє спілкування та взаємодії зі світом може бути захоплюючим, але вимагає уважного підходу та постійної уваги до питань безпеки та етики.