Uno studio innovativo pubblicato su Nature Neuroscience dimostra che le interfacce cervello-computer possono ripristinare efficacemente l’udito selettivo in ambienti rumorosi. Per la prima volta, i ricercatori hanno utilizzato con successo segnali neurali in tempo reale per amplificare automaticamente una voce specifica sopprimendo al tempo stesso il rumore di fondo, offrendo una potenziale soluzione per i 430 milioni di persone in tutto il mondo che convivono con una perdita uditiva invalidante.

La sfida dell'”effetto cocktail party”

Uno degli ostacoli più persistenti nelle neuroscienze uditive è il “problema del cocktail party”, ovvero la difficoltà che gli esseri umani incontrano nell’isolare un singolo interlocutore in mezzo a una folla di voci sovrapposte e rumore di sottofondo.

Mentre l’udito normale si basa sulla capacità naturale del cervello di filtrare il suono in base all’attenzione, gli attuali apparecchi acustici in gran parte non riescono a replicare questa sofisticatezza. I dispositivi tradizionali in genere amplificano indiscriminatamente tutti i suoni in entrata. Questa mancanza di selettività spesso riduce la chiarezza del parlato in ambienti complessi, portando alla frustrazione degli utenti, a bassi tassi di adozione e a un maggiore isolamento sociale per le persone con problemi di udito.

“Abbiamo sviluppato un sistema che agisce come un’estensione neurale dell’utente, sfruttando la capacità naturale del cervello di filtrare tutti i suoni in un ambiente complesso per isolare dinamicamente la conversazione specifica che desidera ascoltare”, ha spiegato la dott.ssa Nima Mesgarani della Columbia University.

Come funziona la tecnologia

Lo studio, condotto dal Dr. Mesgarani e dal Dr. Vishal Choudhari, ha utilizzato un’opportunità unica fornita dai pazienti con epilessia sottoposti a intervento chirurgico per individuare le fonti delle crisi. A questi volontari erano già stati impiantati elettrodi intracranici, consentendo ai ricercatori di misurare l’attività cerebrale con elevata precisione.

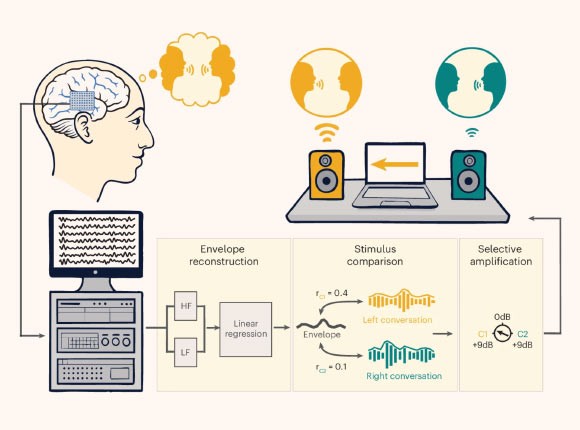

Durante le prove, i partecipanti hanno ascoltato contemporaneamente due conversazioni sovrapposte. Il sistema utilizzava algoritmi di apprendimento automatico in tempo reale per analizzare le onde cerebrali dei soggetti e determinare su quale conversazione si stavano concentrando attivamente.

Una volta identificata la voce di destinazione, il sistema regola immediatamente l’uscita audio:

* Amplificata la voce a cui l’ascoltatore stava prestando attenzione.

* Soppresso la voce concorrente e il rumore di fondo.

Questo processo si è verificato in modo dinamico, sia che i soggetti siano stati guidati a concentrarsi su un parlante specifico sia che abbiano scelto liberamente, imitando le scelte conversazionali del mondo reale.

Dalla teoria all’applicazione pratica

La svolta principale risiede nella velocità e nella stabilità del sistema. Affinché gli apparecchi acustici controllati dal cervello siano utilizzabili, devono elaborare istantaneamente i dati neurali per risultare naturali per l’utente.

Il dottor Vishal Choudhari ha sottolineato l’importanza di questo cambiamento: “La domanda centrale senza risposta era se la tecnologia dell’udito controllata dal cervello potesse andare oltre i progressi incrementali, verso un prototipo che potesse aiutare qualcuno a sentire meglio in tempo reale”.

I risultati sono stati sorprendenti. Una partecipante è rimasta così sorpresa dalla perfetta integrazione della tecnologia che ha accusato i ricercatori di regolare manualmente i volumi alle sue spalle. Altri hanno descritto l’esperienza come “fantascienza”, sottolineando il profondo potenziale per amici e familiari alle prese con la perdita dell’udito.

Una nuova era per la tecnologia acustica

Questa ricerca segna una transizione critica dai modelli teorici alle applicazioni pratiche nel mondo reale. Passando dalla semplice amplificazione al potenziamento selettivo basato sull’intento neurale, questa tecnologia promette di ripristinare le sofisticate capacità di filtraggio del cervello umano.

Con l’avanzare del campo, questi risultati suggeriscono un futuro in cui l’assistenza all’udito non sarà solo una questione di volume, ma di chiarezza e connessione, riducendo potenzialmente le barriere sociali affrontate da milioni di persone con problemi di udito.