Przełomowe badanie opublikowane w czasopiśmie Nature Neuroscience pokazuje, że interfejsy mózg-komputer mogą skutecznie przywracać selektywną percepcję słuchową w hałaśliwym otoczeniu. Po raz pierwszy naukowcom z powodzeniem wykorzystano sygnały neuronowe działające w czasie rzeczywistym, aby automatycznie wzmacniać określony głos i tłumić szum tła. Stanowi to potencjalne rozwiązanie dla 430 milionów ludzi na całym świecie cierpiących na uniemożliwiający ubytek słuchu ograniczający ich codzienne życie.

Problem z przyjęciem koktajlowym

Jednym z najbardziej utrzymujących się problemów neuronauki słuchowej jest „problem przyjęć koktajlowych” — trudność, jaką napotykają ludzie, próbując wybrać jednego mówcę spośród wielu nakładających się głosów i hałasu w tle.

Podczas gdy normalny słuch opiera się na naturalnej zdolności mózgu do filtrowania dźwięków w oparciu o uwagę, nowoczesne aparaty słuchowe w dużej mierze nie są w stanie odtworzyć tej złożoności. Tradycyjne urządzenia zazwyczaj wzmacniają wszystkie przychodzące dźwięki na oślep. Brak selektywności często zmniejsza zrozumiałość mowy w trudnych warunkach, co prowadzi do frustracji użytkowników, niskiego wskaźnika wykorzystania urządzeń i zwiększonej izolacji społecznej osób z ubytkiem słuchu.

„Opracowaliśmy system, który działa jak neuronowe przedłużenie użytkownika, wykorzystując naturalną zdolność mózgu do filtrowania wszystkich dźwięków w złożonym środowisku w celu dynamicznego izolowania konkretnej rozmowy, którą użytkownik chce usłyszeć” – wyjaśniła dr Nima Mesgarani z Uniwersytetu Columbia.

Jak działa ta technologia

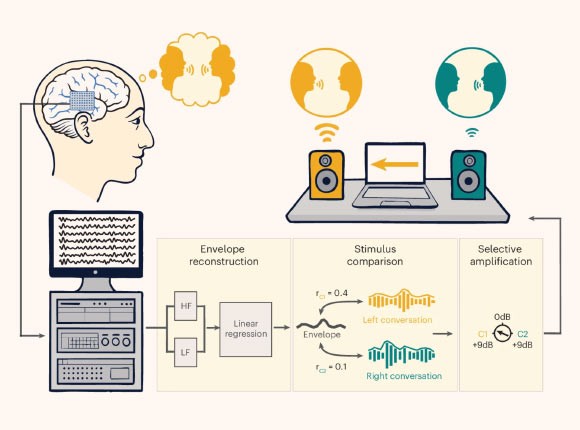

W badaniu prowadzonym przez dr Mesgaraniego i dr Vishala Choudhary’ego wykorzystano wyjątkową możliwość, jaką dają pacjenci z padaczką poddawani zabiegom chirurgicznym, w celu zidentyfikowania źródeł napadów padaczkowych. Ochotnikom tym wszczepiono już elektrody wewnątrzczaszkowe, co umożliwiło naukowcom pomiar aktywności mózgu z dużą precyzją.

Podczas prób uczestnicy słuchali jednocześnie dwóch nakładających się na siebie rozmów. System wykorzystał algorytmy uczenia maszynowego działające w czasie rzeczywistym do analizy fal mózgowych osób badanych i ustalenia, na której rozmowie aktywnie się koncentrowali.

Gdy system zidentyfikował docelowy głos, natychmiast dostosował wyjście audio:

* Wzmocniony głos, na którym skupiona była uwaga słuchacza.

* Wytłumiony konkurencyjny głos i hałas w tle.

Proces ten przebiegał dynamicznie, niezależnie od tego, czy badani byli kierowani do skupienia się na konkretnym mówcy, czy też swobodnie wybierali przedmiot uwagi, co naśladowało rzeczywiste sytuacje konwersacyjne.

Od teorii do praktycznego zastosowania

Główny przełom polega na szybkości i stabilności systemu. Aby aparaty słuchowe sterowane mózgiem były skuteczne, muszą natychmiast przetwarzać dane neuronowe, tak aby wrażenia pozostały naturalne dla użytkownika.

Dr Vishal Choudhary podkreślił znaczenie tej zmiany: „Głównym nierozwiązanym pytaniem było, czy technologia aparatów słuchowych sterowanych mózgiem może wyjść poza stopniowe udoskonalenia i stworzyć prototyp, który mógłby pomóc komuś lepiej słyszeć w czasie rzeczywistym”.

Wyniki były niesamowite. Jedna z uczestniczek była tak zaskoczona płynną integracją technologii, że oskarżyła badaczy o ręczną regulację głośności za jej plecami. Inni opisali to doświadczenie jako „science fiction”, zwracając uwagę na ogromny potencjał dla przyjaciół i członków rodziny zmagających się z ubytkiem słuchu.

Nowa era w technologii słyszenia

Niniejsze badanie oznacza krytyczne przejście od modeli teoretycznych do praktycznych zastosowań w świecie rzeczywistym. Przechodząc od prostego ulepszania do selektywnego wzmacniania opartego na zamiarach neuronowych, technologia ta obiecuje przywrócić złożone zdolności filtrujące ludzkiego mózgu.

W miarę rozwoju tej dziedziny odkrycia te wskazują na przyszłość, w której wsparcie słuchu będzie dotyczyć nie tylko głośności, ale także przejrzystości i połączenia, potencjalnie zmniejszając bariery społeczne napotykane przez miliony osób z ubytkiem słuchu.